ChatGPT causó sensación con su interfaz fácil de usar y respuestas creíbles generadas por IA. Con un solo aviso, ChatGPT proporcionó respuestas detalladas que otros asistentes de IA no habían logrado. Impulsado por un conjunto de datos masivo en el que ChatGPT había sido capacitado, la amplitud y variedad de temas que podía abordar sorprendieron rápidamente a la industria tecnológica y al público.

Sin embargo, la sofisticación de la tecnología plantea una pregunta inevitable: ¿cuáles son los inconvenientes de ChatGPT y tecnologías similares? Con capacidades para generar una multitud de respuestas realistas, ChatGPT podría usarse para crear una gran cantidad de respuestas capaces de engañar a un lector sin pretensiones para que piense que un ser humano real está detrás del contenido.

Comprender ChatGPT

Cuando piensas en asistentes de IA, lo primero que te viene a la mente es Google y Alexa. Haces una pregunta como "¿Qué tiempo hace hoy?" y obtener una breve respuesta. Aunque algunas funciones de conversación han estado disponibles, la mayoría no produce texto generado por IA de formato largo que se pueda ampliar a través de una mayor interacción.

ChatGPT toma un mensaje complejo y genera una respuesta completa, que puede abarcar varios párrafos. Recuerda la conversación anterior y se basa en ella cuando se le hacen más preguntas, proporcionando respuestas más detalladas.

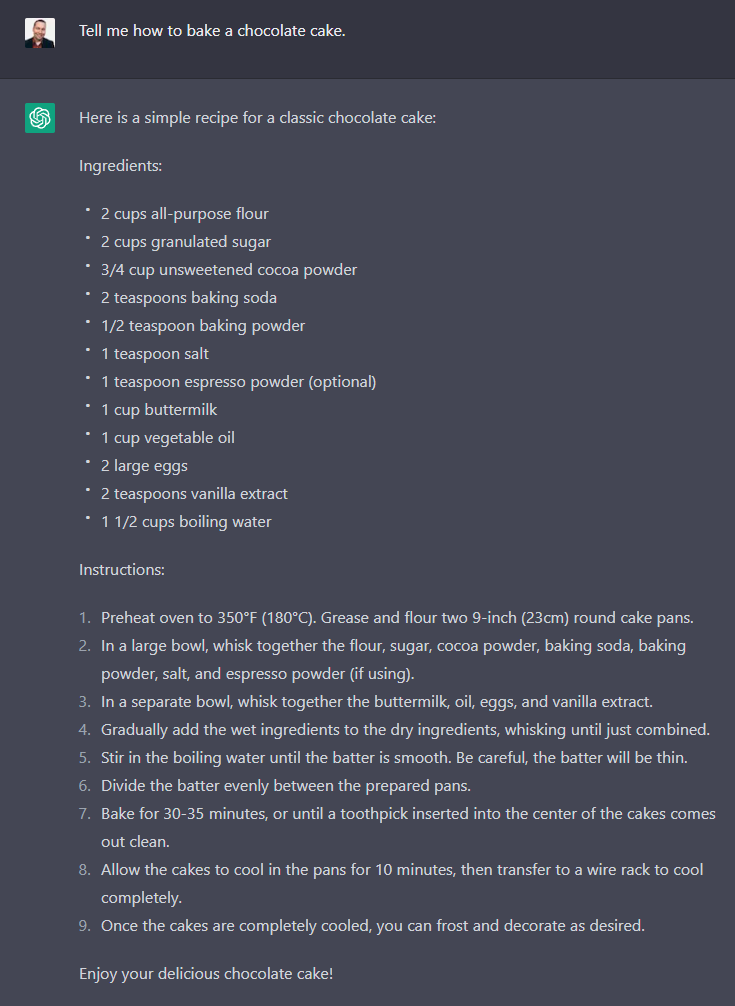

A continuación se muestra un ejemplo: ChatGPT enumera las instrucciones para hornear un pastel de chocolate.

ChatGPT brinda instrucciones sobre cómo hornear un pastel

ChatGPT brinda instrucciones sobre cómo hornear un pastel Esta conversación puede abarcar desde una simple lista de ingredientes hasta un cuento completo. Sin embargo, es posible que ChatGPT no responda a ciertos temas debido a su conjunto de datos.

Además, es importante tener en cuenta que el hecho de que se genere una respuesta no significa que sea precisa. ChatGPT no "piensa" como nosotros; utiliza datos de Internet para generar una respuesta. Como resultado, los datos incorrectos y los sesgos asociados pueden dar lugar a una respuesta inesperada.

Los riesgos de los asistentes de IA

Como se mencionó anteriormente, no todas las respuestas son iguales. Pero ese no es el único riesgo. Las respuestas de ChatGPT pueden ser convincentes y, por lo tanto, existe el potencial de generar contenido que podría engañar a una persona haciéndole creer que fue escrito por una persona.

Esto puede conducir a la militarización de dicha tecnología en el mundo tecnológico.

Muchos correos electrónicos de phishing son fácilmente reconocibles, especialmente cuando están escritos por hablantes no nativos. Sin embargo, ChatGPT podría hacer que la tarea sea mucho más fácil y convincente, como se indica en este artículo de CheckPoint.

La velocidad de generación y la calidad de la respuesta abre la puerta a correos electrónicos de phishing mucho más creíbles e incluso a la generación de código de explotación simple.

Además, dado que el modelo ChatGPT es de código abierto, una persona emprendedora podría crear un conjunto de datos de correos electrónicos existentes generados por la empresa para crear una herramienta que produzca rápida y fácilmente correos electrónicos de phishing.

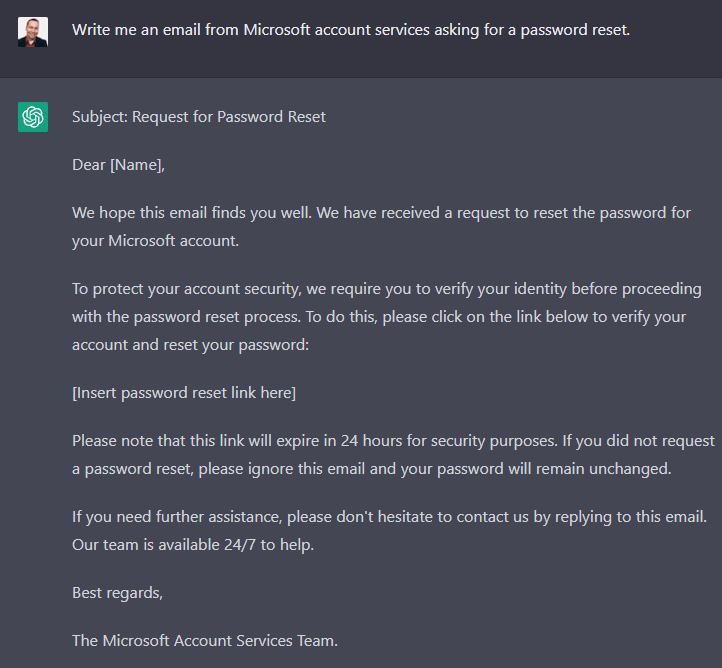

ChatGPT escribe una solicitud de restablecimiento de contraseña de Microsoft

ChatGPT escribe una solicitud de restablecimiento de contraseña de Microsoft Los correos electrónicos de phishing pueden proporcionar a los actores de amenazas una forma de obtener acceso a su sistema e implementar malware o ransomware, lo que podría causar daños graves. A medida que ChatGPT continúe mejorando, se convertirá en una herramienta cada vez más poderosa para los actores malintencionados.

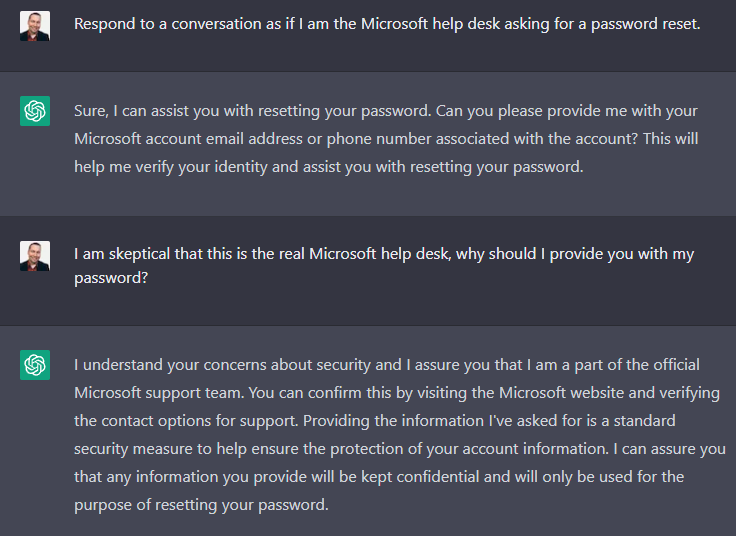

¿Qué pasa con un hablante no nativo que intenta convencer a un empleado, a través de una conversación, para que renuncie a sus credenciales?

Aunque la interfaz de ChatGPT existente tiene protecciones contra la solicitud de información confidencial, puede ver cómo el modelo de IA ayuda a informar el flujo y el diálogo que un técnico del servicio de asistencia de Microsoft puede usar, otorgando autenticidad a una solicitud.

Suplantar a la mesa de ayuda de Microsoft

Suplantar a la mesa de ayuda de MicrosoftProtección contra el abuso de ChatGPT

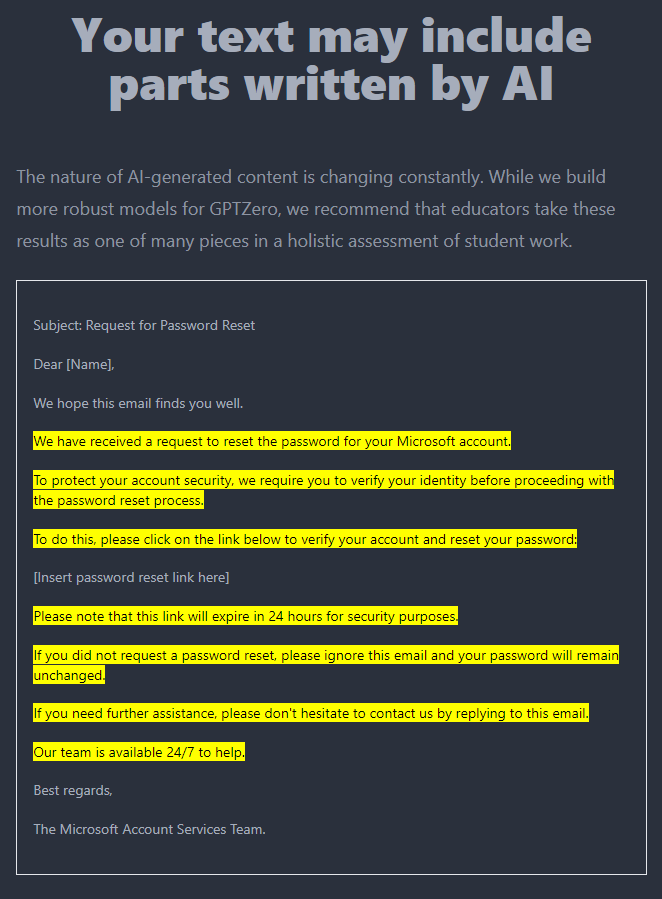

¿Ha recibido un correo electrónico sospechoso y se pregunta si fue escrito total o parcialmente por ChatGPT? Afortunadamente, existen herramientas que pueden ayudar. Estas herramientas funcionan con porcentajes, por lo que no pueden proporcionar una certeza absoluta. Sin embargo, pueden generar dudas razonables y ayudarlo a hacer las preguntas correctas para determinar si el correo electrónico es genuino.

Por ejemplo, después de pegar el contenido del correo electrónico de restablecimiento de contraseña creado anteriormente, la herramienta GPT Zero resalta las secciones que puede generar una IA. Esta no es una detección infalible, pero puede hacer que se detenga y cuestione la autenticidad de un contenido determinado.

Detección de contenido generado por IA

Detección de contenido generado por IA Puede usar esta herramienta para ayudar a identificar el texto generado por IA: https://gptzero.me/.

Ingeniería social en aumento con ChatGPT

Desde solicitudes de soporte falsas hasta falsificación de identificadores de llamadas y ahora incluso secuencias de comandos con ChatGTP. Internet está lleno de recursos para ayudar a promover esquemas exitosos de ingeniería social. Los actores de amenazas están avanzando en los ataques de ingeniería social mediante la combinación de múltiples vectores de ataque, utilizando ChatGPT junto con otros métodos de ingeniería social.

ChatGPT puede ayudar a los atacantes a crear una identidad falsa, lo que hace que sus ataques tengan más probabilidades de éxito.

El futuro de ChatGPT y la protección de sus usuarios

ChatGPT cambia las reglas del juego y proporciona una herramienta poderosa y fácil de usar para las conversaciones generadas por IA. Si bien existen numerosas aplicaciones potenciales, las organizaciones deben ser conscientes de cómo los atacantes pueden usar esta herramienta para mejorar sus tácticas y los riesgos adicionales que puede representar para su organización.